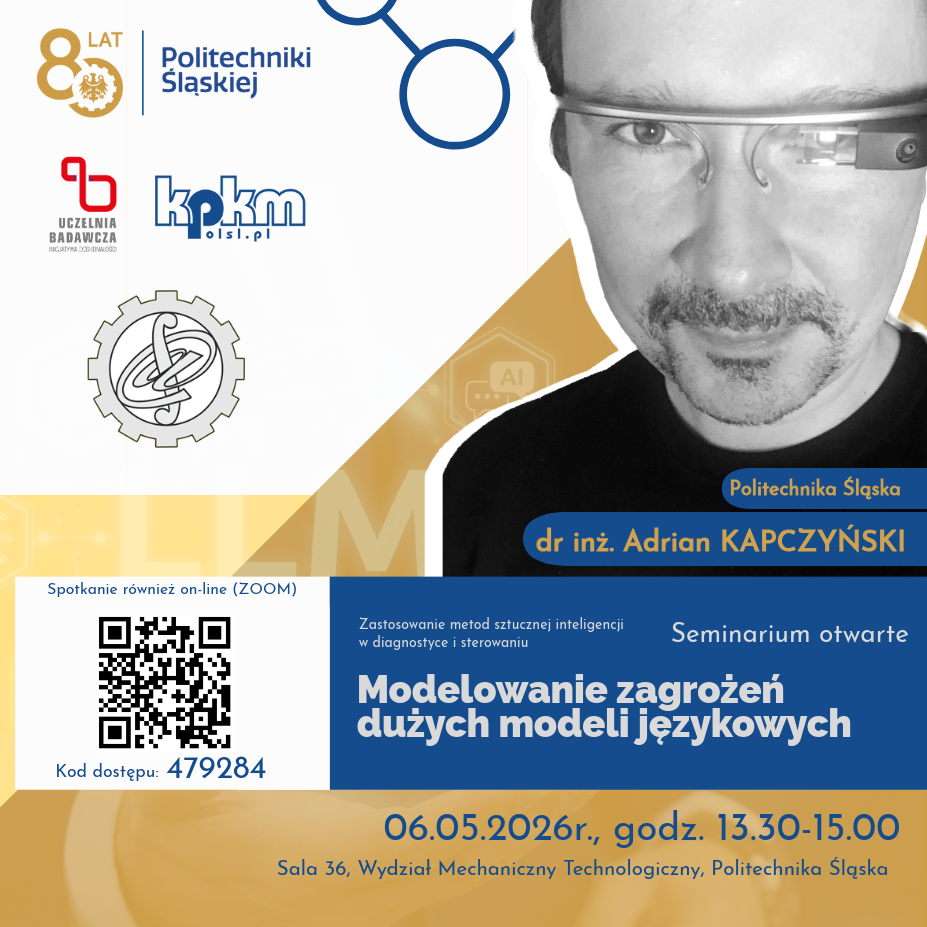

Seminarium otwarte nt. modelowania zagrożeń LLM

Zapraszamy na kolejne seminarium w ramach cyklu „Zastosowanie metod sztucznej inteligencji w diagnostyce i sterowaniu”.

Wykład pt. „Modelowanie zagrożeń dużych modeli językowych” odbędzie się

![]() Biografia prelegenta:

Biografia prelegenta:

Dr inż. Adrian Kapczyński – uczeń Profesora Andrzeja Grzywaka, pasjonat informatyki, od 28 lat zawodowo związany z informatyką oraz jej zastosowaniami. Nauczyciel, menedżer, futurolog, audytor wewnętrzny ISO 27001 oraz ISO 42001, audytor wiodący ISO 27001 i ISO 22301, konsultant strategiczny oraz ekspert z zakresu cyberbezpieczeństwa, specjalizujący się w obszarze biometrii oraz steganografii.

W ramach Politechniki Śląskiej pełni funkcję koordynatora podobszaru badawczego Cyberbezpieczeństwo, kierownika studiów podyplomowych "Cyber Science. Zarządzanie Cyberbezpieczeństwem", lidera zespołu badawczego oraz opiekuna kół naukowych.

Przewodniczący Komitetu nr 309 (ds. biometrii) w ramach Polskiego Komitetu Naukowego. Animator społeczności "17 53c" zajmującej się cyberbezpieczeństwem. Członek organizacji ISACA, IEEE, ACM, ISSA oraz Mensa Polska.

![]() Streszczenie wykładu:

Streszczenie wykładu:

W trakcie prelekcji zostanie przedstawiona pogłębiona analiza architektury dużych modeli językowych (LLM) z perspektywy identyfikacji i klasyfikacji powierzchni ataku, obejmująca pełen cykl życia modelu.

Omówione zostaną kluczowe kategorie zagrożeń charakterystycznych dla systemów generatywnych, w tym techniki manipulacji danymi wejściowymi, mechanizmy eksfiltracji danych oraz ataki adwersaryjne wpływające na integralność i przewidywalność działania modeli.

Ponadto zaprezentowane zostaną zagadnienia związane z ryzykiem wycieku informacji wrażliwych oraz bezpieczeństwem mechanizmów Retrieval-Augmented Generation (RAG) w kontekście ochrony prywatności i zarządzania dostępem do danych.

Ponadto przedstawione zostaną podejścia do modelowania zagrożeń opracowane z myślą systemów opartych na sztucznej inteligencji, wraz z ich odniesieniem do uznanych standardów, takich jak MITRE ATLAS.

Prelekcja będzie skoncentrowana na aktualnych kierunkach badań oraz praktycznych implikacjach projektowania bezpiecznych systemów wykorzystujących duże modele językowe.